网站如何优化才能利用百度蜘蛛的抓取

今天我们结合网站建设的角度来说一下,关于网站结构优化,其URL的优化,那废话不多讲了就开始了……

树型结构优的结构即“页—频道—详情页”;扁平页到详情页的层次尽量少,既对抓取友好又可以很好的传递权重。网状保证每个页面都至少有一个文本链接指向,可以使网站尽可能全面的被抓取收录,内链建设同样对排序能够产生积极作用。导航为每个页面加一个导航方便用户知晓所在路径;子域与目录的选择相信有大批的站长对此有疑问,在我们看来,当内容较少并且内容相关度较高时建议以目录形式来实现,有利于权重的继承与收敛;当内容量较多并且与主站相关度略差时建议再以子域的形式来实现。

网站的简洁美观url规则:性网站中同一内容页只与一个url相对应,过多形式的url将分散该页面的权重,并且目标url在系统中有被滤重的风险;简洁性动态参数尽量少,保证url尽量短;美观性使得用户及机器能够通过url即可判断出页面内容的主旨;

我们推荐如下形式的url:url尽量短且易读使得用户能够快速理解,例如使用拼音作为目录名称;同一内容在系统中只产生的url与之对应,去掉无意义的参数;如果无法保证url的性,尽量使不同形式的url301到目标url;防止用户输错的备用域名301至主域名。

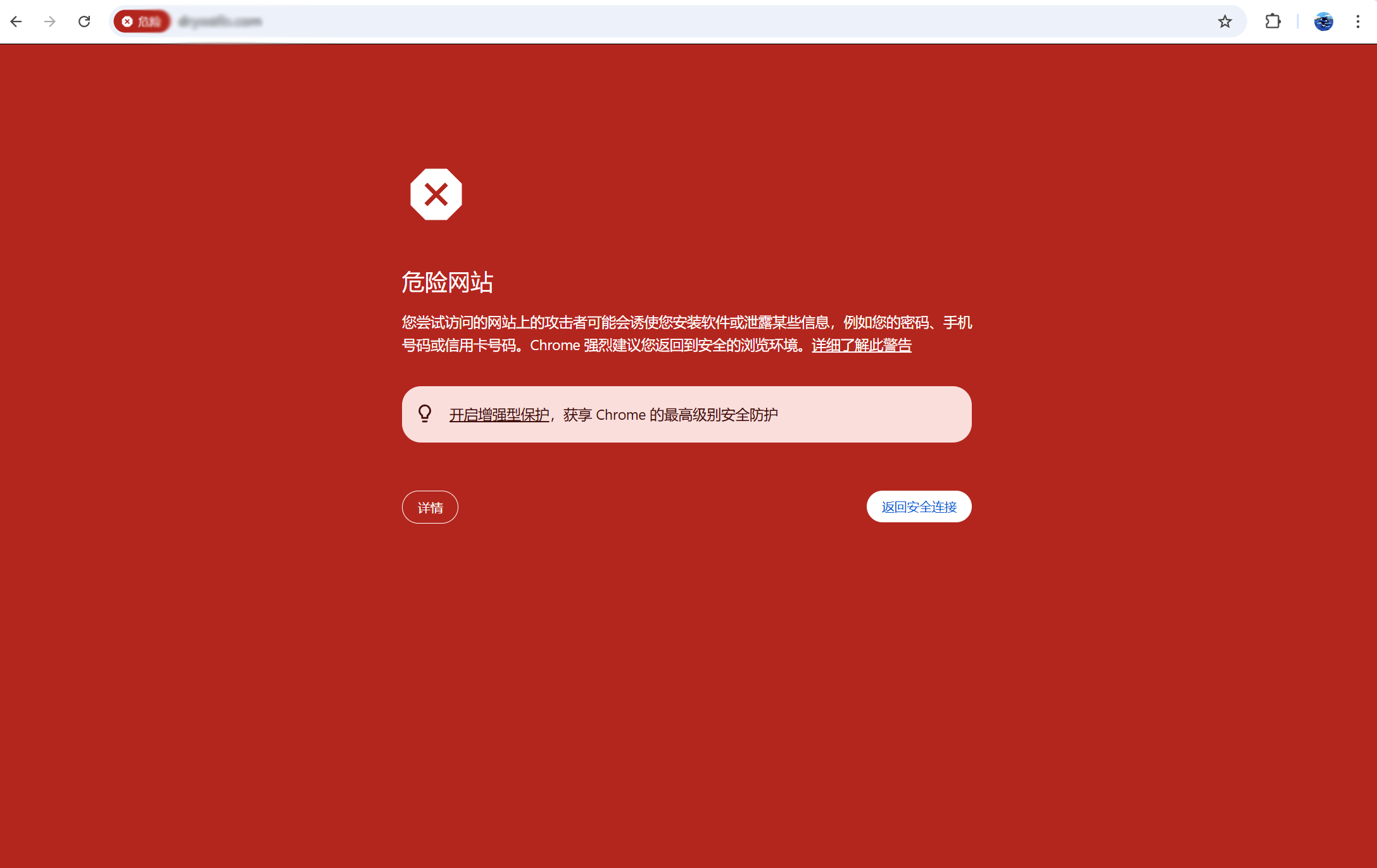

其他注意事项:不要忽略倒霉的robots文件,默认情况下部分系统robots是封禁搜索引擎抓取的,当网站建立后及时查看并书写合适的robots文件,网站日常维护过程中也要注意定期检查;建立网站sitemap文件、死链文件,并及时通过百度站长平台进行提交;部分电商网站存在地域跳转问题,有货无货建议统一做成一个页面,在页面中标识有无货即可,不要此地区无货即返回一个无效页面,由于spider出口的有限性将造成正常页面无法收录。合理利用站长平台提供的robots、sitemap、索引量、抓取压力、死链提交、网站改版等工具。